Claude, el Pentágono y el bombardeo a Irán: la guerra invisible por la IA ya empezó

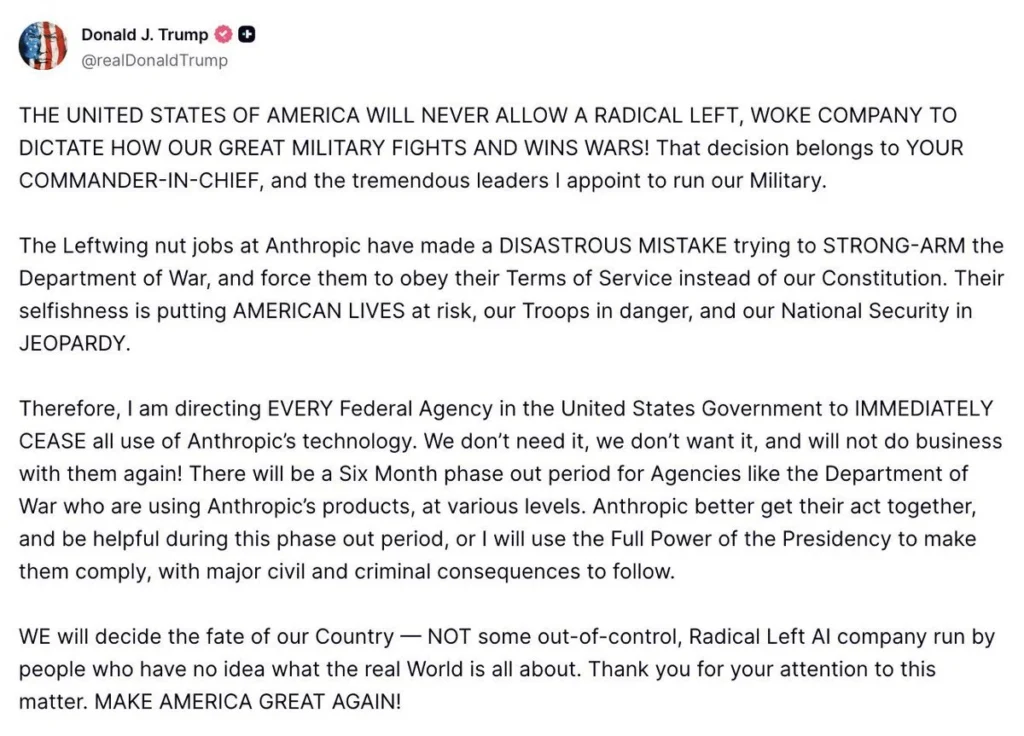

El 28 de febrero no solo hubo explosiones en Irán. También estalló una batalla silenciosa dentro de Estados Unidos: la disputa por qué inteligencia artificial debe usar el brazo militar más poderoso del mundo. Horas antes del ataque, Donald Trump ordenó que se dejara de usar Claude, la IA de Anthropic, calificándola como una “IA woke”. Pero lo que ocurrió después cambió el guion.

Según reportes del Wall Street Journal, herramientas de Claude habrían sido utilizadas para analizar información estratégica, evaluar objetivos y simular escenarios de combate durante la operación. Es decir, mientras públicamente se anunciaba el veto, en la práctica la tecnología seguía profundamente integrada en sistemas críticos del Pentágono.

Pero hay algo más delicado: la dependencia. Claude no era una herramienta aislada; estaba integrada con sistemas de análisis masivo de datos y software estratégico vinculado a Palantir. Expertos estiman que retirar completamente esa infraestructura podría tardar hasta seis meses. En términos militares, eso es una eternidad.

En paralelo, OpenAI ya se mueve. La compañía señaló que Estados Unidos necesita modelos de IA para su defensa frente a amenazas globales. Aunque mantiene principios similares en papel, su postura es más pragmática: el uso final depende de lo que el Departamento de Defensa considere legal. Y ahí está el matiz que podría inclinar la balanza.

El problema no es técnico, es estructural. Anthropic había impuesto límites claros: nada de vigilancia masiva a ciudadanos estadounidenses y nada de control directo sobre armas autónomas. Para el Departamento de Defensa, esos límites eran una fricción. Para la empresa, eran líneas rojas morales. La tensión escaló hasta amenazas de aplicar la Ley de Producción de Defensa de 1950 para forzar el control de la tecnología.

La gran pregunta ya no es si la IA participa en operaciones militares. Eso es un hecho. La pregunta real es quién define los límites: ¿las empresas tecnológicas con su ética interna o los gobiernos con su agenda estratégica? Porque cuando una IA se convierte en pieza clave de la seguridad nacional, dejar de usarla no es tan simple como presionar “desinstalar”.

Esta no es solo una historia sobre Claude o Anthropic. Es el inicio visible de una nueva guerra: la guerra por el control moral, político y estratégico de la inteligencia artificial. Y apenas estamos viendo el primer capítulo.